ChatGPT - Datenschutz-Albtraum oder hilfreiches Werkzeug?

ChatGPT wurde nicht für Privatsphäre entwickelt - wird die EU dieses beliebte Tool jetzt stoppen?

ChatGPT ist das am schnellsten wachsende Online-Tool, das jemals eingeführt wurde. Die Menschen melden sich zu Tausenden an, weil sie glauben, dass es ihnen im Alltag - oder sogar bei der Arbeit - helfen wird.

Aber ist es das wert, sein Recht auf Privatsphäre für die Nutzung der KI aufzugeben?

Studenten nutzen ChatGPT, um Aufsätze von der KI schreiben zu lassen, und einige Nachrichtenseiten wie Buzzfeed kündigten an, ChatGPT zum Schreiben ihrer Artikel zu nutzen - was ihre Aktienkurse in die Höhe schnellen ließ.

Google brauchte nicht lange, um sein eigenes KI-Tool - Bard - anzukündigen, und das chinesische Unternehmen Baidu will seinen KI-Bot "Erni Bot" im März auf den Markt bringen.

Big Tech ist von der neuen KI-Technologie so begeistert, sie wollen, dass wir die Risiken nicht sehen: Die KI wird mit unseren persönlichen Daten gespeist.

ChatGPT Datenschutzdebatte in Europa

Europa, das für sein strenges Datenschutzgesetz DSGVO bekannt ist, befasst sich als erstes mit den Datenschutzproblemen im Zusammenhang mit KI. Italien ist das erste Land in der Europäischen Union, das ein vorübergehendes Verbot verhängt hat, da es einen Verstoß von ChatGPT gegen die Allgemeine Datenschutzverordnung der EU (DSGVO) wittert. Aber der Chatbot könnte Ende April in Italien wieder erlaubt werden: "Am Mittwoch gab die italienische Datenschutzbehörde The Garante OpenAI - dem US-Unternehmen hinter ChatGPT - eine Frist bis zum 30. April, um bestimmte Datenschutzanforderungen zu erfüllen und ebnete damit den Weg für die Aufhebung des vorübergehenden Verbots des Chatbots in dem Land", schreibt Politico.

Italiens Datenschutzbehörde will die Sperrung von ChatGPT durch die Firma OpenAI unter bestimmten Bedingungen aufheben: "Wir sind bereit, eine Rückkehr von ChatGPT am 30. April zu erlauben, wenn OpenAI bereit ist, angemessene Maßnahmen zu ergreifen", sagte der Leiter der Behörde, Pasquale Stanzione, in einem Interview mit der Zeitung Corriere della Sera.

Nach Stanziones Einschätzung ist das von Microsoft unterstützte Unternehmen bereit, die Anforderungen der Datenschutzbehörde umzusetzen.

Künstliche Intelligenz hat mit der Veröffentlichung der Software Wellen in Politik und Wirtschaft geschlagen. Das Programm kann zum Beispiel Anfragen beantworten oder komplette Texte auf der Basis von wenigen Stichworten generieren. Grundlage sind große, vorab eingespeiste Textmengen aus dem Internet.

Je mehr Menschen die generative künstliche Intelligenz nutzen, desto größer werden jedoch die Bedenken hinsichtlich falscher Antworten und des Datenschutzes. Nach Angaben der italienischen Behörden soll OpenAI personenbezogene Daten verarbeitet haben, ohne die Nutzer und Personen zu informieren. Darüber hinaus gab es keine Rechtsgrundlage für die umfangreiche Datenerhebung, die zum Trainieren der KI-Modelle verwendet wurde. Wegen dieser mutmaßlichen Verstöße hatten die italienischen Behörden Ende März Ermittlungen gegen OpenAI eingeleitet. Die KI-Software ist seitdem für italienische Nutzer gesperrt.

Mit Ihren Daten trainiert

OpenAI, das Unternehmen hinter ChatGPT, hat die KI mit Milliarden von Wörtern aus dem Internet trainiert - mit Büchern, Artikeln, Zeitungen, Aufsätzen. Die KI wurde mit allen möglichen Informationen aus dem Internet gefüttert, ohne die Zustimmung der Autoren.

Wenn Sie jemals etwas online gepostet haben - sei es ein Blogbeitrag oder nur ein Kommentar unter einem Artikel - ist es sehr wahrscheinlich, dass ChatGPT diese Informationen für sein Training verwendet hat.

Verleger erhalten nichts

Problematisch ist auch die Entschädigung von Herausgebern von Online-Inhalten. Blogartikel oder Bücher können über ChatGPT zitiert werden, aber die eigentlichen Autoren erhalten keine Vergütung. Je nach Popularität des Textes entgehen der Industrie wahrscheinlich enorme Einnahmen - während OpenAI wahrscheinlich immens profitieren wird.

Was ist falsch an KI-Daten?

Es gibt mehrere Gründe, warum die Verwendung von Informationen aus dem Internet für das Training einer KI, die dann neue Texte produziert, problematisch ist.

Die Daten könnten falsch sein: Nicht alle im Internet veröffentlichten Daten sind korrekt. Tatsächlich ist das Internet voll von Propaganda, Lobbyismus und Meinungsartikeln.

Die Daten könnten aus geschützten Quellen stammen, was zu rechtlichen Konflikten führen könnte.

Die Daten können privat sein: Viele Daten im Internet enthalten persönliche Informationen über Personen, manchmal sogar ihre Adressen oder andere private Informationen, die ihre Identität preisgeben könnten. Diese Informationen wurden ohne die Zustimmung der Betroffenen abgegriffen und stellen somit eine klare Verletzung der Privatsphäre dar.

Darüber hinaus haben die Betroffenen keine Möglichkeit herauszufinden, ob ChatGPT ihre Daten verwendet, geschweige denn diese Daten aus der Datenbank entfernen zu lassen. Dies ist eine gesetzliche Anforderung der Europäischen Datenschutzgrundverordnung (DSGVO), so dass es fraglich ist, ob ChatGPT diese EU-Datenschutzverordnung einhält. Das von der DSGVO garantierte "Recht auf Vergessenwerden" ist besonders wichtig, wenn die von ChatGPT verwendeten Informationen falsch sind - was leider ziemlich oft der Fall ist.

Ausblick in der EU

Zum jetzigen Zeitpunkt lässt sich nicht sagen, ob und in welchem Umfang ChatGPT - und andere KI-Tools wie Bard oder Ernie Bot - in der EU reguliert werden. Was mit Sicherheit gesagt werden kann, ist dies: Die Politik und vor allem die Datenschützer in Europa und in den USA schauen sich die KI-Tools, ihre Möglichkeiten, aber auch ihren potenziellen Schaden genau an.

"Wir sind noch Jahre davon entfernt, dass das KI-Gesetz anwendbar ist, und es ist entscheidend, dass die Verbraucher in der Zwischenzeit geschützt werden", sagte Frederico Oliveira da Silva, leitender Jurist beim Europäischen Verbraucherverband (BEUC), gegenüber EURACTIV.

Oliveira zufolge sollten die EU und die nationalen Behörden unverzüglich eine Untersuchung der Risiken von ChatGPT und ähnlichen groß angelegten Sprachtools einleiten. Es sei eine "stärkere öffentliche Kontrolle" erforderlich.

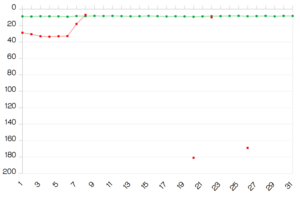

Nachdem Italien im vergangenen Monat den Zugang zur KI blockiert hatte, reichte die spanische Datenschutzbehörde (AEPD) kürzlich eine Petition beim Europäischen Datenschutzausschuss (EDPB) ein, in der sie auf die Notwendigkeit hinwies, die Auswirkungen von ChatGPT auf die Privatsphäre zu bewerten.

In Frankreich reichte der Europaabgeordnete Eric Bothorel kürzlich eine Beschwerde bei der französischen Datenschutzbehörde CNIL ein, nachdem diese bereits mit der Untersuchung mehrerer Beschwerden begonnen hatte. In Deutschland prüft die Datenschutzkonferenz derzeit ebenfalls, ob der Chatbot gegen die Datenschutzgrundverordnung verstößt.

Belgien, Österreich, Kroatien, Finnland und Polen haben bisher noch keine Pläne, die Software zu verbieten.

Eine Regulierung von KI-Tools zeichnet sich am Horizont ab, aber in welcher Form genau, ist noch unklar.

ChatGPTs Datenschutzbestimmungen

Wenn Sie ChatGPT trotzdem nutzen möchten, sollten Sie zuerst die Datenschutzbestimmungen lesen.

Seien Sie sich bewusst, dass OpenAI eine Menge Informationen über Sie sammelt. Laut der Datenschutzrichtlinie des Unternehmens werden die IP-Adresse, der Browsertyp und die Browsereinstellungen sowie Daten über die Interaktionen der Benutzer mit der Website gesammelt - einschließlich der Art der Inhalte, die sie nutzen, der Funktionen, die sie verwenden und der Aktionen, die sie ausführen. Es werden sogar Daten über die Surfgewohnheiten und die von Ihnen besuchten Websites erfasst. Darüber hinaus gibt OpenAI an, dass es die gesammelten Informationen an Dritte weitergeben kann. In Anbetracht der Tatsache, dass Microsoft stark in OpenAI investiert ist, sollte man sich darüber im Klaren sein, dass dieses große Technologieunternehmen vollen Zugriff auf alle Ihre Daten erhalten könnte, die Sie mit ChatGPT teilen.

Fazit

Auch wenn ChatGPT die Art und Weise, wie wir arbeiten, revolutionieren kann, müssen wir die Kosten bedenken. OpenAI ist ein gewinnorientiertes Unternehmen, und wir sollten mit den Daten, die wir mit ihm teilen, vorsichtig sein.

Die Risiken für den Schutz der Privatsphäre sind alarmierend, während die Vorteile von ChatGPT - zumindest bis jetzt - noch sehr begrenzt sind.

Nicht nur, dass einige Informationen, die ChatGPT wiedergegeben hat, falsch sind, sondern auch, dass die KI Texte produziert, die manchmal wie langweilige Zusammenfassungen von Hunderten von Blogbeiträgen zu diesem Thema wirken.

Wenn Sie nicht überzeugt sind, lesen Sie dieses von ChatGPT produzierte Beispiel:

Schreiben Sie einen Aufsatz darüber, warum Datenschutz wichtig ist und warum wir in unserem digitalen Zeitalter eine Ende-zu-Ende-Verschlüsselung brauchen.

Wir sind sicher, dass Sie selbst einen solchen Aufsatz schreiben könnten. Jetzt können Sie überprüfen, wer besser abschneidet: Sie oder die KI.

Lesen SIe den Aufsatz zum Thema Datenschutz von ChatGPT:

Datenschutz ist wichtig: Die Bedeutung der Ende-zu-Ende-Verschlüsselung im digitalen Zeitalter

Das digitale Zeitalter hat unzählige Vorteile mit sich gebracht, von der sofortigen Kommunikation bis hin zum unvergleichlichen Zugang zu Informationen. Da wir uns jedoch zunehmend auf Technologie verlassen, um uns zu vernetzen, zu kommunizieren und Geschäfte zu tätigen, hinterlassen wir auch große Mengen an persönlichen Daten, die von Unternehmen, Regierungen und anderen Organisationen erfasst, gespeichert und weitergegeben werden können.

Aus diesem Grund ist der Datenschutz so wichtig, denn er ermöglicht es dem Einzelnen, die Autonomie und Kontrolle über seine persönlichen Daten und sein Verhalten zu behalten.

Die Bedeutung des Datenschutzes

In der heutigen Welt sind persönliche Daten wertvoll und können für eine Vielzahl von Zwecken verwendet werden, z. B. für gezielte Werbung, politische Manipulation und sogar Überwachung. Wenn persönliche Daten ohne unser Wissen oder unsere Zustimmung gesammelt, gespeichert und weitergegeben werden, verlieren wir die Kontrolle über unser eigenes Leben. Unsere Handlungen, Gedanken und Überzeugungen können von Personen oder Organisationen überwacht und analysiert werden, die diese Informationen nutzen können, um uns zu manipulieren oder auszubeuten. Darüber hinaus kann der Verlust der Privatsphäre zu Diskriminierung führen, insbesondere bei gefährdeten Gruppen wie Minderheiten, Einwanderern und politisch Andersdenkenden.

Ende-zu-Ende-Verschlüsselung

Hier kommt die Ende-zu-Ende-Verschlüsselung ins Spiel, eine Technik, die eine sichere Kommunikation ermöglicht, indem die Daten auf dem Gerät des Absenders verschlüsselt werden, so dass sie nur auf dem Gerät des Empfängers entschlüsselt werden können. Auf diese Weise wird sichergestellt, dass nur der Absender und der Empfänger die Nachricht lesen können und dass sie nicht von Dritten abgefangen oder eingesehen werden kann, auch nicht von dem Unternehmen, das den Dienst anbietet.

Schutz unserer politischen und bürgerlichen Rechte

Die Ende-zu-Ende-Verschlüsselung spielt auch eine entscheidende Rolle beim Schutz unserer politischen und bürgerlichen Rechte. In einer Gesellschaft, in der die Menschen ihre Ansichten und Meinungen frei und ohne Angst vor Repressalien äußern können, kann ein robuster Markt der Ideen gedeihen. In einer Gesellschaft, in der die Privatsphäre nicht respektiert wird, kann der Einzelne das Gefühl haben, ständig überwacht zu werden, und sich selbst zensieren, um Repressalien zu vermeiden. Dies kann sich abschreckend auf die Redefreiheit und andere Rechte auswirken und es dem Einzelnen erschweren, in vollem Umfang am demokratischen Prozess teilzunehmen.

Vertrauen und Sicherheit im menschlichen Miteinander

Der Schutz der Privatsphäre ist auch wichtig für die Sicherheit und das Vertrauen in menschliche Interaktionen. Wenn wir darauf vertrauen können, dass unsere persönlichen Daten vertraulich behandelt werden, sind wir eher bereit, unsere Gedanken, Gefühle und Erfahrungen mit anderen zu teilen. Dies führt zu tieferen, bedeutungsvolleren Beziehungen und einem stärkeren Gemeinschaftsgefühl. Wenn wir hingegen das Gefühl haben, dass unsere persönlichen Daten ständig offengelegt werden, werden wir möglicherweise zurückhaltender und gehen weniger leicht Verbindungen zu anderen ein.

Fazit

Zusammenfassend lässt sich sagen, dass die Privatsphäre ein Grundrecht ist, das es uns ermöglicht, die Autonomie und Kontrolle über unsere persönlichen Daten und unser Verhalten zu behalten. Sie ist wichtig für den Schutz unserer politischen und bürgerlichen Rechte, die Förderung von Vertrauen und Sicherheit in zwischenmenschlichen Beziehungen und die Wahrung der Menschenwürde. Die Ende-zu-Ende-Verschlüsselung ist ein leistungsfähiges Instrument, das dazu beitragen kann, unsere Privatsphäre im digitalen Zeitalter zu schützen, indem es gewährleistet, dass unsere Kommunikation sicher und privat ist.

Da wir uns zunehmend auf die Technologie verlassen, um uns zu verbinden, zu kommunizieren und Geschäfte zu tätigen, ist es wichtig, dass wir Maßnahmen zum Schutz unserer Privatsphäre ergreifen, und dazu gehört auch die Nutzung von Diensten, die eine Ende-zu-Ende-Verschlüsselung anbieten.