El desprecio por la privacidad va de la mano de la militarización de la tecnología.

Tanto la extracción de datos como la misoginia deben detenerse ayer mismo.

Por qué es importante la privacidad

Esta historia es un recordatorio crítico de por qué es importante la privacidad: Incluso si no tienes nada que ocultar. No somos datos o métricas de negocio, somos personas, y cuando las empresas no se dan cuenta de ello, las consecuencias son reales.

Responsabilidad de las grandes tecnológicas

En marzo, una aplicación para crear vídeos "DeepFake FaceSwap" desplegó más de 230 anuncios en los servicios de Meta, incluidos Facebook, Instagram y Messenger, según una revisión de la biblioteca de anuncios de Meta. Algunos de los anuncios mostraban lo que parecía el comienzo de vídeos pornográficos con el sonido de introducción de la plataforma porno Pornhub reproduciéndose. Segundos después, los rostros de las mujeres se cambiaban por los de actores famosos. Los pies de foto de docenas de estos anuncios decían "Cambia la cara por cualquiera" y "Diviértete con la tecnología de intercambio de caras AI".

Después de que NBC News pidiera comentarios a Meta, todos los anuncios de la aplicación fueron retirados de los servicios de Meta. Aunque en los vídeos no se mostraban actos sexuales, su naturaleza sugerente ilustra cómo la aplicación puede utilizarse potencialmente para generar contenido sexual falso, no sólo con mujeres famosas, sino que funciona con una sola foto de la cara de alguien subida por el usuario de la aplicación. Los mismos anuncios también se vieron en aplicaciones gratuitas de edición de fotos y juegos descargadas de la App Store de Apple, donde la aplicación apareció por primera vez en 2022 de forma gratuita para mayores de 9 años, y también estaba disponible para su descarga gratuita en Google Play, donde fue clasificada como "Adolescente" por "temas sugerentes" Tanto Apple como Google dijeron que más tarde retiraron la aplicación de sus tiendas después de haber sido contactados por NBC News.

¿Es tarea de los periodistas buscar aplicaciones abusivas en las tiendas de aplicaciones?

La misma historia se repitió con otra aplicación en diciembre de 2021 tras una investigación de Reuters.

Decenas de aplicaciones deepfake siguen disponibles en las tiendas de aplicaciones de Google y Apple, la mayoría de ellas utilizadas para generar porno no consentido y "desnudar" a la gente. Aunque Google y Apple afirman que prohíben las aplicaciones que generan contenidos difamatorios, discriminatorios o susceptibles de intimidar, humillar o dañar a alguien, esto es exactamente lo que ha estado ocurriendo delante de sus narices. Google ha añadido las "imágenes pornográficas sintéticas involuntarias" a su lista de prohibiciones, lo que permite a cualquier persona solicitar al motor de búsqueda que bloquee los resultados que le muestren falsamente "desnudo o en una situación sexual explícita", pero ¿deben ser las víctimas las responsables de arreglar esto o debe Google hacer un mejor trabajo para prevenir este tipo de abuso en primer lugar?

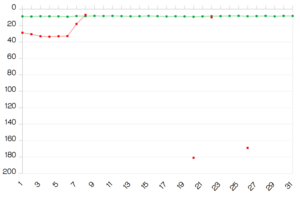

A medida que la tecnología deepfake ha ido mejorando y extendiéndose, el mercado de imágenes sexuales no consentidas se ha disparado. Algunos sitios web permiten a los usuarios vender porno deepfake no consentido desde detrás de un muro de pago. Un estudio de 2019 de DeepTrace encontró que el 96% del material deepfake en línea es de naturaleza pornográfica, mientras que otro estudio de Genevieve Oh encontró que el número de videos pornográficos deepfake casi se ha duplicado cada año desde 2018.

Dado que la tecnología para detectar deepfake existe, aunque detrás de muros de pago, ¿por qué todas las plataformas que permiten a los usuarios subir fotos y vídeos no los filtran automáticamente y etiquetan automáticamente los deepfakes como tales? Ya están fallando en la identificación y eliminación de contenido abusivo, pero al menos esta parte debería ser lo suficientemente fácil si realmente les importara.

Nada nuevo

Recientemente, un artículo de Katie Jgln se adentraba en la extensa historia de la violencia de género facilitada por la tecnología. Algunos de los ejemplos más "de la vieja escuela", como las cámaras ocultas en los baños, siguen utilizándose: hace tan sólo unos días, el Departamento de Justicia de Estados Unidos presentó cargos contra un hombre que presuntamente colocó una cámara en el interior de un baño a bordo de un crucero de Royal Caribbean y filmó a 150 personas, entre ellas 40 menores.

TechSafety tiene una serie de guías útiles y la Clínica para Acabar con el Abuso Tecnológico (CETA) de la Universidad de Cornell también tiene recursos para ayudar a las personas a proteger su privacidad y a mantenerse seguras en línea, y su amplia investigación en colaboración con la Universidad de Nueva York muestra lo sistémicos que son el abuso en línea y el abuso posibilitado por la tecnología, especialmente cuando están impulsados por la misoginia y la transfobia.

Además de sus publicaciones académicas revisadas por pares, también enlazan a algunos artículos de los medios de comunicación más accesibles para un profano, como:

Ellobby inalámbrico enreda el futuro del proyecto de ley contra la violencia doméstica - Axios

Conexión no deseada: ¿Quién controla tu casa inteligente? - The New York Times

Cientos de aplicaciones permiten a los acosadores rastrear a sus víctimas - The New York Times

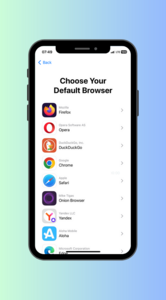

Lasencilla forma en que Apple y Google permiten a los maltratadores domésticos acechar a sus víctimas - WIRED

Cómo las aplicaciones de acoso permiten a las parejas maltratadoras espiar a sus víctimas - MIT Technology Review

Cómo los maltratadores utilizan los smartphones para esp iar a sus parejas - Vox

No hay refugio seguro para las víctimas del maltrato digital - Slate

Nuevas herramientas para detectar el maltrato doméstico digital - Cornell Chronicle

Lasaplicaciones facilitan el espionaje a los maltratadores - Cornell Chronicle

Cómo la tecnología está fallando a las víctimas de la violencia de pareja - Freedom to Tinker (Princeton CITP)

Aplicaciones de control parental: ¿en qué se diferencian del stalkerware? - Malwarebytes Labs

Hay una yuxtaposición interesante entre la visión de la organización de que las voces de los supervivientes de abusos, acoso y otros malos tratos sean el centro del diseño tecnológico y el hecho de que su investigación esté patrocinada en parte por Google y Meta. Es estupendo que estos gigantes de la tecnología destinen parte de sus beneficios a arrojar luz sobre los problemas que ellos mismos contribuyen a crear, pero sería aún mejor que tuvieran realmente en cuenta los resultados de las investigaciones que patrocinan y mejoraran sus productos en consecuencia.

Otros ejemplos muy extendidos de este tipo de utilización de la tecnología como arma son:

- La intimidación y el acoso, incluidas las amenazas físicas. Los agresores desdibujan los límites entre la violencia en línea y fuera de línea, como se detalla en un extenso informe mundial de la Economist Intelligence Unit, que también mide el impacto de la violencia en línea contra las mujeres en la economía y la sociedad en general. Muchos tiroteos masivos han sido casos de violencia en línea que se traducen en acciones en el mundo real; el último ejemplo es el del tirador del centro comercial de Allen, Texas, que tenía un perfil en las redes sociales lleno de diatribas contra negros, asiáticos y judíos y contra las mujeres en general. Los vínculos entre la violencia racializada y la violencia de género están documentados desde hace mucho tiempo.

- Doxing: se utiliza especialmente contra las personas trans, y suele ir acompañado de intentos de despedir a la víctima de su trabajo y desahuciarla de su casa, así como de empujarla a autolesionarse.

- AirTags deApple y otros dispositivos similares

- Dispositivos domésticos inteligentes, como termostatos, cerraduras y luces.

Como dice Katie Jgln, a menudo "la tecnología moderna -y el mundo en línea que ha creado- no es más que una extensión del patriarcado. [...] Hace la vista gorda ante -y a menudo incluso permite- el mismo abuso, acoso, violencia, misoginia, sexismo, hipersexualización no deseada y cosificación que experimentamos en el mundo real. Y al igual que muchas otras herramientas del patriarcado -por ejemplo, la cultura de la pureza o los roles de género "tradicionales"- con demasiada frecuencia sirve para ponernos en nuestro lugar, silenciar o desacreditar nuestras voces y, lo que es más importante, proteger un statu quo".

La difusa línea que separa el stalkerware de las "aplicaciones normales"

La Coalición contra el Stalkerware señala que "aunque el término stalkerware también se utiliza a veces coloquialmente para referirse a cualquier app o programa que invade o se percibe que invade la privacidad de una persona; creemos que es importante una definición clara y estrecha dado el uso del stalkerware en situaciones de abuso por parte de la pareja". El hecho de que haya serios motivos de confusión en este asunto no es una buena señal para empresas como Google, Meta y muchas otras empresas de aplicaciones de mensajería, correo electrónico, redes sociales y otros servicios que requieren permisos sensibles en tu teléfono y recopilan tus datos. También reconocen "que las aplicaciones legítimas y otros tipos de tecnología pueden desempeñar, y a menudo desempeñan, un papel en este tipo de situaciones". En la misma página, uno de los criterios recomendados para detectar el stalkerware es "aplicaciones capaces de recopilar y filtrar datos confidenciales de los usuarios de dispositivos (por ejemplo, datos de localización, contactos, registros de llamadas/textos, contraseñas, historial de navegación, etc.) sin su consentimiento y/o conocimiento continuos". ¿Cuántas de las aplicaciones más descargadas del mundo NO cumplen estos criterios?

No tiene por qué ser así. Las aplicaciones para padres nunca tienen que estar ocultas en el teléfono; si lo están, son programas de acoso, no aplicaciones para padres. Los teléfonos no necesitan tener el GPS activado por defecto. Las aplicaciones no necesitan tener permisos de localización (y muchos otros) por defecto (o nunca, en muchos casos), en su lugar, los usuarios deben optar por activar estos permisos cuando sea necesario sólo para las aplicaciones que legítimamente lo necesitan. Todos los teléfonos deberían retirar automáticamente los permisos a las aplicaciones que no estés utilizando. Los AirTags, Tiles y otros productos similares deberían tener siempre notificaciones sonoras cuando están activados o en uso, y los reguladores deberían tomar medidas enérgicas contra las versiones "modificadas" que se venden en eBay, etc.

No podemos esperar que las empresas tecnológicas sacrifiquen los beneficios que obtienen en el actual sistema capitalista de vigilancia por compasión y respeto a la humanidad de cada persona. Tenemos que aumentar constantemente la presión sobre ellas para que lo hagan. Hasta entonces, no estaremos a salvo. Debemos seguir luchando por nuestro derecho a la privacidad.